AI 딜레마: 혁신, 규제, 책임의 균형 맞추기, AI Safety Summit 2023

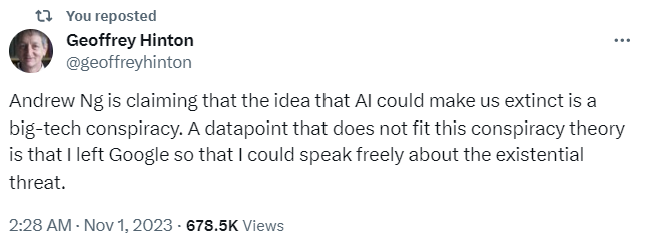

2023년 10월 31일 할로윈에 앤드류 응(Andrew Ng), 얀 르쿤(Yann LeCun), 제프리 힌튼(Geoffrey Hinton) 등 저명한 인사들이 참여한 SNS(X)의 최근 대화에서 인공지능(AI)에 대한 논의가 시작되었습니다. 어떤 이야기가 오갔는지 살펴볼까요?

서론(Introduction)

인공지능(AI) 기술의 급속한 발전은 이 분야의 전문가, 연구자 사이에서 복잡하고 다각적인 논쟁을 촉발시켰습니다. 최근 앤드류 응(Andrew Ng), 얀 르쿤(Yann LeCun), 제프리 힌튼(Geoffrey Hinton) 등 저명한 인사들이 참여한 대담에서는 AI의 위험과 혜택, 공개 연구의 역할, 책임 있는 개발의 중요성을 둘러싼 다양한 관점을 조명했습니다. 이 글에서는 이러한 논의를 자세히 살펴보고 AI 커뮤니티 내의 주요 주장과 반론을 살펴봅니다.

과장된 위험과 혁신(Overhyped Risks and Innovation)

저명한 AI 교육자이자 Google Brain의 공동 창립자인 앤드류 응(Andrew Ng)은 AI와 관련된 과장된 위험, 특히 인간 멸종에 대한 두려움에 대해 우려를 제기합니다. 응(Andrew Ng)은 이러한 과장된 두려움이 규제를 강화하고 오픈소스 AI 개발과 혁신을 저해할 수 있다고 우려합니다. 그는 이러한 두려움으로 인해 젊은 학생들이 AI 분야에 뛰어드는 것을 꺼리게 되고, 규제 조치가 개방적인 연구를 방해할 수 있는 의도하지 않은 결과를 지적합니다.

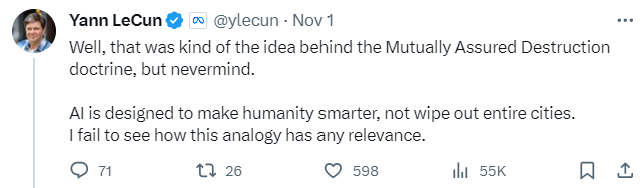

이에 대해 Facebook AI의 수석 AI 과학자 얀 르쿤(Yann LeCun)은 응(Andrew Ng)의 관점에 반박합니다. 르쿤(Yann LeCun)은 인간은 AI를 통제할 수 있는 주체성을 가지고 있으며, 이 기술이 잠재적으로 인류를 멸종 위기에서 구할 수 있다고 주장합니다. 또한 그는 개방적인 연구와 혁신을 제한할 수 있는 과도한 규제에 대해서도 경계합니다. 그의 입장은 AI의 잠재력과 미래를 형성하는 데 있어 인간의 역할에 대한 보다 낙관적인 시각을 반영합니다.

딥 러닝의 선구자인 제프리 힌튼(Geoffrey Hinton)은 영상의학 전문의가 쓸모없어질 것이라는 초기 예측에도 불구하고 AI가 의료를 포함한 다양한 산업에 큰 영향을 미칠 수 있다는 점을 인정하며 논의에 가세했습니다. 힌튼(Geoffrey Hinton)은 AI가 계속해서 발전하여 다양한 영역에서 가치 있는 지원을 제공할 것이라고 전망합니다.

AI의 이점(Benefits of AI)

로한 아닐(Rohan Anil)은 AI가 약속하는 중요한 이점을 상기시키며 인류의 시급한 단기적 문제를 해결하는 데 도움이 될 수 있는 잠재력을 강조합니다. 아닐(Rohan Anil)의 관점은 AI의 잠재력이 지닌 이중적인 성격을 강조하며, 중요한 문제를 해결할 수 있는 능력과 동시에 도전 과제를 제기할 수 있다는 점을 강조합니다.

빅테크와 오픈소스에 대한 비판(Critiques of Big Tech and Open Source)

업계 관찰자로 추정되는 ΜΛΛNΙ은 제프리 힌튼(Geoffrey Hinton)이 구글을 떠난 것이 AI 발전에 긍정적인 조치였다고 주장하며 대기업의 AI 발전을 비판합니다. 이에 대해 힌튼(Geoffrey Hinton)은 트랜스포머와 확산 모델과 같은 혁신적 모델의 개발을 언급하며 AI 혁신에 대한 구글의 공헌을 옹호합니다. 그는 구글이 새로운 기술을 출시할 때 신중한 접근 방식을 취하기 때문에 구글의 발전에 대한 인식이 왜곡될 수 있다고 설명합니다.

역사적 유추와 책임(Historical Analogies and Responsibility)

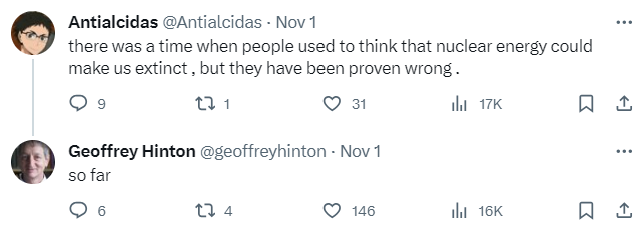

안티알시다스(Antialcidas)는 원자력 에너지가 인류 멸종을 초래할 것이라는 초기 우려와 역사적 유사성을 제기했고, 이에 대해 제프리 힌튼(Geoffrey Hinton)은 "아직까지는(so far)"이라는 모호한 답변으로 답했습니다. 힌튼(Geoffrey Hinton)의 답변은 AI가 원자력의 초창기와 마찬가지로 아직 결과가 불확실한 발전 중인 분야라는 점을 인정한 것입니다.

규제 딜레마(The Regulatory Dilemma)

이러한 대화의 핵심은 AI를 둘러싼 규제 딜레마에 있습니다. 앤드류 응(Andrew Ng)은 AI의 잠재적 위험성에 대한 두려움이 해로운 규제로 이어져 오픈소스 개발과 혁신을 저해할 수 있다는 우려를 표명합니다. 얀 르쿤(Yann LeCun)은 응(Andrew Ng)과 다른 사람들이 의도치 않게 AI 연구와 개발을 방해할 수 있는 제한적인 규제를 지지하고 있다고 비난합니다. 책임감 있는 개발을 보장하는 것과 혁신을 촉진하는 것 사이의 이러한 긴장은 AI 커뮤니티에서 중요한 도전 과제입니다.

혁신, 책임, 규제의 균형 맞추기(Balancing Innovation, Responsibility, and Regulation)

이 저명한 AI 인사들의 대화는 AI 환경의 복잡성을 강조합니다. 책임감 있는 AI 개발의 필요성과 혁신을 촉진해야 하는 의무 사이에서 균형을 맞추는 방법에 대한 지속적인 논쟁이 반영되어 있습니다. 응(Andrew Ng)과 같이 잠재적 위험과 규제 조치에 대처하는 것이 중요하다고 강조하는 사람이 있는 반면, 르쿤(Yann LeCun)과 같이 개방적인 연구와 개발을 허용하는 규제에 대한 보다 신중한 접근 방식을 주장하는 사람도 있습니다.

미래 과제(대화와 협력)

앤드류 응(Andrew Ng), 얀 르쿤(Yann LeCun), 제프리 힌튼(Geoffrey Hinton), 그리고 다른 참가자들이 참여한 토론은 AI 커뮤니티의 복잡한 역학 관계를 조명합니다. 이 토론은 AI에 대한 위험과 혜택, 적절한 규제 접근 방식에 대한 지속적인 논쟁을 보여줍니다. AI 기술이 계속 발전함에 따라 혁신과 책임, 규제 사이의 적절한 균형을 찾는 것이 핵심 과제로 남을 것이며, 이를 위해서는 해당 분야 전문가들 간의 지속적인 대화와 협력이 필요합니다.

댓글